KI, die niemand bestellt hat: 11 Einfallstore und das 3-Zonen-Modell

Ihr Collaboration-Tool fasst seit dem letzten Update automatisch Ihre Meetings zusammen. Ihr Buchhaltungsdienstleister nutzt KI, um Abschlüsse schneller zu liefern. Ihre Firewall blockiert verdächtige Anfragen auf Basis eines KI-Modells. Hat jemand in Ihrem Unternehmen für all das aktiv Ja gesagt?

In den meisten KMU lautet die ehrliche Antwort: nein. Und genau das ist die Lücke, die jede KI-Governance-Initiative zuerst schliessen muss.

Pascal Beck

13. März 2026

Das Wichtigste in Kürze

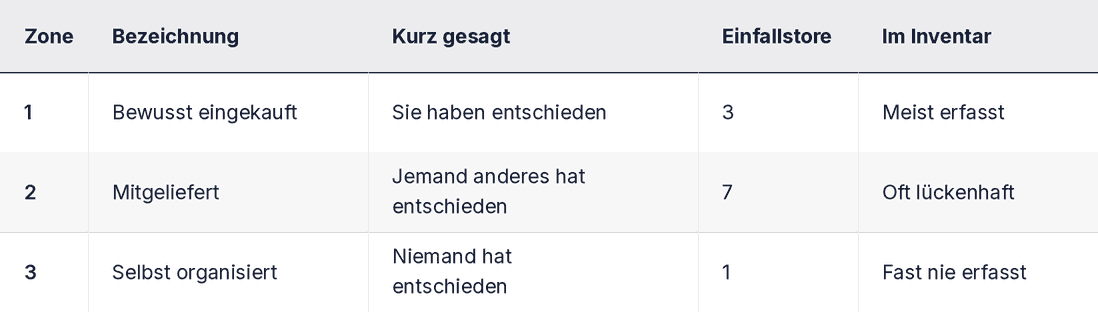

KI gelangt über 11 Pfade ins Unternehmen, die sich in drei Zonen einteilen lassen: bewusst eingekauft, mitgeliefert, selbst organisiert

Zone 1 haben die meisten Unternehmen gut im Griff. Zone 2 ist der grösste blinde Fleck.

Wer sein KI-Inventar nur aus Zone 1 aufbaut, erfasst einen kleinen Teil der tatsächlich laufenden Systeme

Art. 26 EU AI Act verpflichtet Deployer, für alle eingesetzten KI-Systeme einzustehen, unabhängig davon, ob sie bewusst eingekauft wurden

Ein kurzer Selbsttest zeigt Ihnen in fünf Fragen, wo Ihre Governance heute steht

Das 3-Zonen-Modell: Eine Leitfrage, die alles ordnet

Bevor wir die elf Einfallstore einzeln durchgehen, braucht es ein mentales Modell. Die entscheidende Frage für jeden KI-Einfalltsor lautet:

Hat jemand in Ihrem Unternehmen dafür Ja gesagt?

Die Antwort ergibt drei Zonen:

Die meisten KI-Governance-Programme sind in Zone 1 stark und in Zone 2 weitgehend blind. Das ist kein Versäumnis, es ist ein Strukturproblem. Zone 1 ist sichtbar. Zone 2 kommt mit dem nächsten Software-Update, mit dem Dienstleister-Onboarding, mit der neuen Firewall. Wer Zone 2 nicht aktiv sucht, findet sie nicht.

Zone 1: Die KI, für die Ihr Unternehmen Ja gesagt hat

Zone 1 ist der einfachere Teil. Jemand hat entschieden. Es gibt einen Vertrag, einen Einkaufsprozess, eine Ansprechperson. Das macht Governance zumindest möglich.

1. Kauf von KI-Applikationen

Sie erwerben ein KI-Tool oder ein SaaS-Produkt mit KI-Funktionalität: einen KI-gestützten Kundendienst, ein Prognose-Tool, ein Dokumentenmanagement mit semantischer Suche. Das ist der sichtbarste Einfalltsor und in den meisten Unternehmen bereits durch Beschaffungsprozesse abgedeckt.

Aber Sichtbarkeit ist nicht dasselbe wie guter Governance-Stand. Hochrisiko-KI-Systeme nach EU AI Act, etwa KI in HR-Entscheidungen oder Kreditprüfungen, erfordern mehr als einen Einkaufsschritt. Art. 26 verlangt Risikobeurteilung, Dokumentation und menschliche Aufsicht. Wie viele Ihrer eingekauften KI-Tools sind in diesem Sinne tatsächlich beurteilt?

Massnahme: Beschaffungsprozess um eine KI-spezifische Risikobeurteilung erweitern. Anbieter muss auf Anfrage Konformitätsdokumentation gemäss EU AI Act vorlegen können.

2. Eigenentwicklung von KI-Applikationen

Interne Teams oder externe Partner bauen KI-Lösungen von Grund auf. Der Governance-Aufwand ist hier am grössten: Wer selbst KI entwickelt und einsetzt, trägt unter Umständen Provider- und Deployer-Pflichten gleichzeitig. In KMU betrifft das häufig kleinere Automatisierungen oder ML-Modelle für spezifische Geschäftsprozesse.

Massnahme: Verbindliche Entwicklungsrichtlinien für KI aufsetzen, die Modellauswahl, Trainingsdaten, Verwendungszweck und Risikoeinstufung festlegen. Ohne diese Grundlage ist eine spätere Compliance-Prüfung kaum möglich.

3. Updates bestehender Lösungen

Softwareanbieter ergänzen bestehende Produkte durch Updates um KI-Funktionen, oft ohne separate Kommunikation. Ein ERP, das plötzlich Nachfrageprognosen generiert. Ein CRM, das Leads automatisch bewertet. Ein HR-Tool, das Bewerbungen vorsortiert.

Das sind neue KI-Systeme im Sinne der Governance, auch wenn kein neuer Vertrag unterzeichnet wurde. Die Entscheidung, mit diesem Anbieter zu arbeiten, kam aus Zone 1. Aber die Entscheidung, diese neue KI-Funktion einzusetzen, hat oft niemand bewusst getroffen.

Massnahme: Release Notes kritischer Systeme systematisch auswerten. Jedes neue KI-Feature braucht einen eigenen Governance-Schritt, inklusive Risikoeinstufung.

Zone 2: Die KI, für die jemand anderes Ja gesagt hat

Sieben Einfallstore, alle mit demselben Grundmuster: Die KI ist real, sie läuft, sie verarbeitet möglicherweise Ihre Daten. Aber niemand in Ihrer Organisation hat eine Entscheidung dafür getroffen.

4. Drittanbieter mit KI-gestützten Leistungen

Externe Dienstleister erbringen Leistungen mit Hilfe von KI, ohne dass das vertraglich geregelt ist. Das betrifft jeden Anbieter mit Zugang zu Ihren Unternehmensdaten: den Steuerberater, den IT-Dienstleister, die Personalvermittlung. Sobald diese Anbieter KI einsetzen, betrifft das Ihre Governance-Pflichten direkt.

Unter revDSG und DSGVO gilt: Wer personenbezogene Daten an Dritte weitergibt, trägt Mitverantwortung für deren Verarbeitung. Das schliesst KI ein, auch wenn Sie das Modell nie zu Gesicht bekommen.

Massnahme: Lieferantenverträge um drei konkrete KI-Klauseln erweitern: Offenlegungspflicht bei KI-Nutzung, Regelung zur Datenverarbeitung durch KI-Systeme, Auditrecht bei Hochrisiko-Anwendungen.

5. Stille KI in Geräten und Diensten

KI ist in Produkten eingebettet, ohne dass Nutzer das wissen oder explizit zugestimmt haben. Smartbuilding-Systeme, Drucker mit Mustererkennung, Videokonferenzlösungen mit Echtzeit-Hintergrundanpassung, Sicherheitskameras mit Bewegungsanalyse: Das sind KI-Systeme im Sinne der EU-Definition, auch wenn sie sich nicht als solche vermarkten.

Was dabei viele übersehen: Manche dieser Systeme verarbeiten personenbezogene Daten von Mitarbeitenden oder Besuchern. Eine Risikobeurteilung dafür hat in den meisten KMU niemand vorgenommen.

Massnahme: Transparenzanforderungen in Beschaffungsverträge aufnehmen. Anbieter ist vertraglich zu verpflichten, KI-Komponenten offenzulegen, bevor ein Kauf abgeschlossen wird.

6. KI in Netzwerk- und Infrastrukturkomponenten

Firewalls, Intrusion-Detection-Systeme und Sicherheitslösungen enthalten zunehmend KI-Funktionen für Anomalieerkennung und automatisierte Reaktionen auf Bedrohungen. Diese Systeme stehen selten im Fokus von Governance-Projekten, obwohl sie vollautomatisch Entscheidungen mit realen Konsequenzen treffen.

Ein Netzwerksicherheitssystem, das einen Nutzer bei verdächtigem Verhalten automatisch sperrt, ist ein KI-System. Ist es in Ihrem Inventar?

Massnahme: Infrastrukturanbieter in die Lieferantenbeurteilung einbeziehen und explizit nach KI-Funktionen fragen. Wer keine klare Antwort gibt, ist ein Governance-Risiko.

7. KI-gestützte Bots und Assistenten

Collaboration-Plattformen wie Microsoft Teams, Slack oder Zoom integrieren KI-Assistenten, die nach Updates häufig automatisch aktiviert sind. Teams sendet seit einem Update automatisch KI-generierte Meeting-Protokolle. Copilot analysiert E-Mails und Kalendereinträge. Die Daten werden dabei in Cloud-Infrastruktur verarbeitet. Hat jemand in Ihrem Unternehmen geprüft, ob das mit Ihrem Datenschutzkonzept nach revDSG vereinbar ist?

Massnahme: Plattform-Einstellungen nach jedem grösseren Update prüfen. Opt-in statt Opt-out für alle Funktionen mit Zugang zu Kommunikationsdaten.

8. Cloud-KI-APIs

Entwickler oder IT-Mitarbeitende binden KI-Modelle über APIs in bestehende Prozesse ein, oft ohne formalen Einkaufsprozess, weil Testversionen kostenlos sind. OpenAI, Google Vertex AI, Anthropic: Solche Integrationen entstehen in Stunden. Ein Inventareintrag dafür existiert fast nie.

Das Ergebnis ist greifbar: Produktionsdaten gelangen in externe KI-Dienste, manchmal inklusive Kundendaten, ohne Datenschutz-Assessment, ohne Dokumentation.

Massnahme: API-Governance-Prozess einführen. Jede neue KI-API-Integration braucht eine Genehmigung und einen Inventareintrag, bevor sie in produktive Umgebungen geht. Keine Ausnahmen für Pilotprojekte.

9. KI in IoT- und Edge-Geräten

Vernetzte Sensoren, Produktionskameras und Logistikfahrzeuge treffen lokal KI-gestützte Entscheidungen, ohne Daten in eine Cloud zu schicken. Gerade in produzierenden KMU sind solche Systeme verbreitet. Ihre Entscheidungslogik ist schwerer zu überprüfen als die cloudbasierter Alternativen, und sie tauchen selten in IT-Inventaren auf, geschweige denn in KI-Inventaren.

Massnahme: Edge-Geräte explizit in die KI-Inventarisierung einbeziehen und gesondert auf Entscheidungsautonomie beurteilen: Wo trifft das Gerät lokal Entscheidungen, die Menschen oder Prozesse betreffen?

10. KI in Geschäftsprozessen (ERP, CRM, Workflows)

ERP-Systeme, CRM-Lösungen und Workflow-Tools enthalten KI-gestützte Automatisierungen: Kreditprüfungen, Priorisierung von Support-Tickets, Bestandsoptimierung. Diese KI wirkt direkt in operativen Kernprozessen und trifft häufig Entscheidungen, die Personen betreffen oder Compliance-Anforderungen berühren.

Prozessverantwortliche wissen oft nicht, dass hinter einer "automatischen Empfehlung" ein KI-Modell steckt. Entsprechend fehlt die Dokumentation, eine menschliche Prüfinstanz gibt es nicht, und im Audit-Fall lässt sich die Entscheidungslogik nicht rekonstruieren.

Massnahme: Prozessverantwortliche müssen KI-gestützte Schritte in ihrer Prozessdokumentation explizit ausweisen. Wo KI Entscheidungen mit Personenbezug trifft, ist menschliche Überprüfung nicht optional.

Zone 3: Die KI, für die niemand Ja gesagt hat

Ein einziger Einfalltsor. Aber strukturell der schwierigste.

11. Shadow AI: Nutzung durch Mitarbeitende

Mitarbeitende verwenden KI-Tools eigenständig und ohne Genehmigung. ChatGPT, Perplexity, Gemini, branchenspezifische Tools: erreichbar per Browser, kostenlos, und oft leistungsfähiger als das, was die IT bereitstellt. Laut Branchenbeobachtungen nutzt ein erheblicher Anteil von Wissensarbeitenden KI-Tools ausserhalb des offiziellen IT-Katalogs. In einem 50-Personen-Unternehmen sind das statistisch gesehen Dutzende Menschen.

Die Risiken sind konkret: Kundendaten in Drittanbieter-Systemen ohne Auftragsverarbeitungsvertrag, KI-generierte Outputs ohne Verifikation in Geschäftsdokumenten, fehlende Dokumentation für Audits.

Ein Verbot löst das Problem nicht. Es verlagert es. Wer ChatGPT auf dem Firmengerät sperrt, nutzt es auf dem Privathandy, mit denselben Unternehmensdaten und weniger Sichtbarkeit für die IT.

Massnahme: Keine Verbotspolitik, sondern eine AI-Nutzungsrichtlinie mit einem Ampelsystem: Welche Tools sind freigegeben, welche toleriert, welche verboten und warum. Kombiniert mit Monitoring und regelmässiger Sensibilisierung.

Selbsttest: Wo steht Ihr Unternehmen?

Fünf Fragen. Die meisten Leser geraten bei der zweiten oder dritten ins Stocken:

1. Welche Software-Updates haben in den letzten 12 Monaten neue KI-Funktionen in Ihre bestehenden Systeme gebracht?

2. Haben Ihre drei wichtigsten Drittanbieter vertraglich offengelegt, ob sie KI in der Erbringung Ihrer Leistungen einsetzen?

3. Welche KI-Assistenten und automatisierten Funktionen sind in Ihren Collaboration-Plattformen (Teams, Slack, Zoom) derzeit aktiv?

4. Welche Cloud-KI-APIs nutzen Ihre IT-Mitarbeitenden oder Entwickler in produktiven Systemen?

5. Gibt es in Ihrem Unternehmen eine AI-Nutzungsrichtlinie, die Mitarbeitende kennen und der sie folgen?

Zone 1 wird gut beantwortet. Zone 2 und Zone 3 kaum. Das ist die Lücke.

Wie bauen Sie ein KI-Inventar, das alle drei Zonen abdeckt?

Ein vollständiges KI-Inventar entsteht nicht durch eine einmalige Umfrage an die IT-Abteilung.

Zuerst müssen alle möglichen Quellen erfasst werden: alle SaaS- und On-premise-Applikationen, Infrastrukturkomponenten, aktive API-Integrationen, externe Dienstleister mit Datenzugang, Hardware mit Netzwerkanschluss. Eine vollständige Liste ist in den meisten KMU länger als erwartet.

Dann kommt die systematische Befragung. Für jede Quelle gilt: Ist KI enthalten? Welche Daten verarbeitet sie? Werden automatisierte Entscheidungen getroffen? Liegt Dokumentation des Anbieters vor? Diese Fragen lassen sich als standardisierter Fragebogen an Anbieter senden oder als strukturiertes Interview mit Prozessverantwortlichen führen.

Danach folgt die Klassifikation nach EU-AI-Act-Risikoklassen. Hochrisiko-Systeme benötigen intensive Dokumentation und menschliche Aufsicht. GPAI-Modelle wie ChatGPT unterliegen eigenen Transparenzpflichten. Low-Risk-Systeme wie Spam-Filter erfordern weniger Aufwand. Die Klassifikation bestimmt, wo Sie wie viel Zeit investieren.

Der letzte Schritt ist der wichtigste und wird am häufigsten übersprungen: Die Inventarisierung muss in bestehende Prozesse integriert werden. Neue Einkäufe, Updates und Mitarbeiterentscheidungen verändern das Inventar laufend. Ohne feste Verankerung im Beschaffungsprozess und im Change Management ist es nach sechs Monaten veraltet.

Ein vollständiges KI-Inventar ist der erste Schritt eines KI Governance Frameworks.

Häufig gestellte Fragen

Was ist ein KI-Inventar, und warum ist es Pflicht?

Ein KI-Inventar ist eine strukturierte Übersicht aller KI-Systeme, die ein Unternehmen einsetzt oder durch Dritte einsetzen lässt, mit Zweck, Risikoeinstufung und Dokumentationsstand. Art. 26 EU AI Act verpflichtet Deployer, ihre Hochrisiko-KI-Systeme zu kennen, zu überwachen und zu dokumentieren. Ohne Inventar ist das strukturell nicht möglich.

Gilt der EU AI Act für Schweizer KMU?

Direkt gilt der EU AI Act in der Schweiz nicht. Unternehmen mit EU-Marktbezug sind jedoch indirekt betroffen: durch Anbieterpflichten, Vertragsanforderungen von Grosskunden und die zunehmende Orientierung der Schweizer Regulierung am EU-Rahmen. Dazu kommen die eigenen Anforderungen des revDSG an automatisierte Entscheidungen mit Personenbezug. Wer heute anfängt, hat morgen einen Vorsprung.

Wie erkenne ich Shadow AI in meinem Unternehmen?

Durch Netzwerk-Monitoring auf Traffic zu bekannten KI-Diensten, anonymisierte Mitarbeiterbefragungen und Analyse von Browser-Extensions. Effektiver als Erkennung ist Prävention: Eine klare Nutzungsrichtlinie mit genehmigten Alternativen reduziert die Anreize für Shadow AI, ohne das Problem durch ein Verbot zu verlagern.

Was passiert, wenn ein KI-System im Inventar fehlt?

Im besten Fall nichts. Im schlechtesten Fall entstehen Datenschutzverletzungen mit Meldepflicht, oder ein Audit durch einen Grosskunden legt Lücken offen. Enterprise-Kunden fragen heute in Ausschreibungen und Vendor-Assessments explizit nach dem KI-Governance-Stand. Ohne vollständiges Inventar ist eine glaubwürdige Antwort schlicht nicht möglich.

Wie lange dauert eine erste KI-Inventarisierung in einem KMU?

In Unternehmen mit 10 bis 100 Mitarbeitenden dauert eine strukturierte Erstinventarisierung typischerweise zwei bis vier Arbeitstage, wenn externe Unterstützung dabei ist. Das Ergebnis ist kein perfektes Register, sondern ein belastbarer erster Stand. Der grösste Zeitaufwand liegt nicht in der Dokumentation, sondern in der Befragung von Anbietern und Prozessverantwortlichen.

Fazit: Zone 1 allein genügt nicht

Die meisten KI-Governance-Programme konzentrieren sich auf die KI, für die jemand Ja gesagt hat. Der eigentliche Compliance-Blind-Spot liegt in der KI, für die jemand anderes Ja gesagt hat, und der KI, für die niemand Ja gesagt hat.

Zone 1 zu kennen ist notwendig. Es ist aber kein Governance-Programm, es ist eine Einkaufsliste.

Nehmen Sie den Selbsttest ernst. Wenn Sie drei der fünf Fragen nicht beantworten können, ist das kein Versagen. Es ist der Ausgangspunkt.

Navigant begleitet Schweizer KMU bei der strukturierten KI-Inventarisierung als erstem Schritt eines pragmatischen Governance-Aufbaus. Vereinbaren Sie ein unverbindliches Erstgespräch und erfahren Sie, in welchen Zonen Ihr Unternehmen heute steht.

Wie eine strukturierte KI-Inventarisierung in einem Online-Handel ablief: Fallbeispiel

Jeden Montag:

Was letzte Woche in AI Governance passiert ist und was es für Ihr KMU heisst.

Die wichtigsten AI-Governance-Entwicklungen der Woche, eingeordnet und auf den Punkt gebracht. Damit Sie montags wissen, was sich ändert und was Sie tun müssen.

Jeden Montag:

Was letzte Woche in AI Governance passiert ist und was es für Ihr KMU heisst.

Die wichtigsten AI-Governance-Entwicklungen der Woche, eingeordnet und auf den Punkt gebracht. Damit Sie montags wissen, was sich ändert und was Sie tun müssen.